Reconocimiento de voz raspberry pi

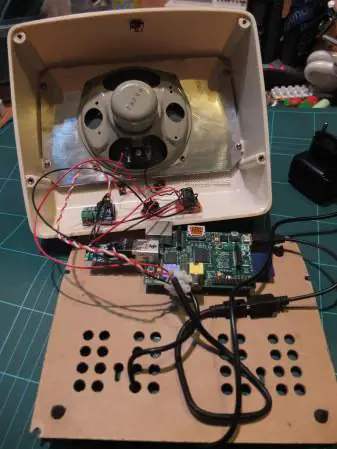

micrófono raspberry pi

Soplar una frambuesa, una fresa, o hacer un grito del Bronx, es hacer un ruido parecido a una flatulencia que puede significar burla, real o fingida. También puede utilizarse en los juegos fonéticos de la infancia, ya sea sólo por parte del niño, o por parte de los adultos hacia el niño para fomentar la imitación para deleite de ambas partes. Se realiza colocando la lengua entre los labios, o colocando alternativamente los labios contra cualquier zona de la piel, y soplando. Cuando se realiza contra la piel de otra persona, suele ser una forma de cosquillas. En la terminología de la fonética, el primer sonido se ha descrito como un trino lingüolabial sordo, [r̼̊],[1] y como un trino interdental bucal, [ↀ͡r̪͆].[2]

La frambuesa (cuando se usa con la lengua) nunca se utiliza en el lenguaje humano fonéticamente (es decir, como bloque de construcción de palabras). Sin embargo, el trino bilabial (esencialmente soplar una frambuesa con los labios) es un fonema en algunas lenguas. Soplar una frambuesa se utiliza ampliamente en todas las culturas humanas [cita requerida].

Spike Jones y sus City Slickers utilizaron un «birdaphone» para crear este sonido en su grabación de «Der Fuehrer’s Face», arremetiendo repetidamente contra Adolf Hitler con: ¡»We’ll Heil! (Aplausos del Bronx) ¡Heil! (Bronx cheer) ¡Justo en la cara de Der Fuehrer!»[3][4]

raspberry pi usb

No está mal. 1,529 segundos para un archivo de sonido de 1,975 segundos. Es más rápido que el tiempo real.Nvidia Jetson Nano run:deepspeech –model deepspeech-0.7.*-models.tflite –scorer deepspeech-0.7.*-models.scorer –audio audio/2830-3980-0043.wav

Hm .. un poco más lento que Raspberry Pi. Es de esperar, ya que la CPU Nvidia Jetson es menos potente que la Raspberry Pi 4. No hay binarios pre-construidos para la arquitectura arm64 con soporte de GPU en este momento, por lo que no podemos aprovechar la GPU de Nvidia Jetson Nano para la aceleración de la inferencia. No creo que esta tarea esté en la hoja de ruta del equipo de DeepSpeech, así que en un futuro próximo investigaré por mi cuenta y trataré de compilar ese binario para ver qué ganancias de velocidad se pueden conseguir utilizando la GPU. Pero los segundos siguen siendo una velocidad bastante decente y, dependiendo de su proyecto, puede optar por ejecutar DeepSpeech en la CPU y tener la GPU para otras tareas de aprendizaje profundo.Windows 10/Linuxdeepspeech –model deepspeech-0.7.*-models.tflite –scorer deepspeech-0.7.*-models.scorer –audio audio/2830-3980-0043.wav

reconocimiento de voz en raspberry pi offline

En este artículo, vamos a ejecutar y comparar el motor DeepSpeech ASR (reconocimiento automático de voz) de Mozilla en diferentes plataformas, como Raspberry Pi 4(1 GB), Nvidia Jetson Nano, Windows PC y Linux PC.

2019, el año pasado, fue el año en el que Edge AI se convirtió en la corriente principal. Múltiples empresas han lanzado placas y chips para la inferencia rápida en el borde y han aparecido una plétora de marcos y modelos de optimización. Hasta la fecha, en mis artículos y vídeos, he centrado mi atención principalmente en el uso del aprendizaje automático para la visión por ordenador, pero siempre me ha interesado ejecutar proyectos de ASR basados en el aprendizaje profundo en un dispositivo embebido. El problema hasta hace poco era la falta de motores sencillos, rápidos y precisos para esa tarea. Cuando investigaba este tema hace un año, las pocas opciones para cuando había que ejecutar ASR (no sólo detección de palabras calientes, sino transcripción de gran vocabulario) en, por ejemplo, Raspberry Pi 3 eran:

Y un par más. Ninguno de ellos era fácil de configurar y no era especialmente adecuado para ejecutarlo en un entorno con recursos limitados. Así que, hace unas semanas, empecé a mirar en esta área de nuevo y después de algunas búsquedas ha tropezado con el motor DeepSpeech de Mozilla. Lleva un tiempo en el mercado, pero hace poco (diciembre de 2019) han lanzado una versión 0.6.0 de su motor ASR, que viene con el modelo.tflite entre otras mejoras significativas. Ha reducido el tamaño del modelo inglés de 188 MB a 47 MB. «DeepSpeech v0.6 con TensorFlow Lite se ejecuta más rápido que en tiempo real en un solo núcleo de una Raspberry Pi 4», afirmó Reuben Morais de Mozilla en el anuncio de la noticia. Así que decidí verificar esa afirmación por mí mismo, ejecutar algunos benchmarks en diferente hardware y hacer mi propia aplicación de transcripción de audio con detección de palabras en caliente. Veamos los resultados.

reconocimiento de voz en raspberry pi python

De los posibles motores de RV, los mejores candidatos parecen ser PocketSphinx o Julius corriendo bajo Jasper. He eliminado Kaldi como candidato debido a sus requisitos de RAM y CPU. Simon fue eliminado como candidato ya que parece muy centrado en el escritorio.

Comience con una imagen de Raspberry Pi. Esta es una imagen guardada después de seguir la Guía de Configuración Inicial de la RPi, la Guía del Punto de Acceso WiFi de la RPi y los Mods de Escritorio de la RPi. La imagen no debe ser Lite. Si no tiene tal imagen, comience con una imagen de Raspbian y siga las guías mencionadas antes de volver aquí. Esta guía asume que usted tiene una imagen apropiada y está conectado a su pi en funcionamiento.

Gran parte de la documentación para configurar un micrófono USB se refiere a versiones de Raspbian anteriores a Jessie. Dado que nuestra distribución base es Jessie o más reciente, estas no se aplican. Esta guía sigue el stackexchange, ¿Cómo configuro mi sonido para Jasper en Raspbian Jessie?

Un entorno virtual es una herramienta para mantener las dependencias requeridas por diferentes proyectos en lugares separados, mediante la creación de entornos virtuales de Python para ellos. Jasper, un proyecto python que ayuda a convertir el reconocimiento de voz en comandos, tiene un número de dependencias que pueden entrar en conflicto con el sistema operativo Linux instalado. Un entorno virtual ayudará mucho con esto. Consulta la documentación de The Hitchhiker’s Guide to Python y Virtualenv.